Cisco CodeGuard: El Framework Open-Source que Blinda el Código Generado por IA

Con la explosión de asistentes de IA, la seguridad del código que generan es una preocupación crítica. Analizamos Cisco CodeGuard, un nuevo framework open-source que promete asegurar nuestros proyectos desde el inicio.

Facu Guardia

Análisis técnico: Un guardián en tres actos

Los asistentes de IA son una maravilla, pero a veces tienen la seguridad de un colador. Código con defaults inseguros, validaciones que brillan por su ausencia, secretos a la vista de todos... un verdadero dolor de cabeza. Cisco acaba de tirar sobre la mesa una solución con Project CodeGuard, un framework open-source diseñado para meter en vereda a nuestros copilotos de IA.

La propuesta es simple pero potente: un sistema de reglas que se integra en todo el ciclo de vida del desarrollo. Actúa en tres momentos clave: antes de generar el código, guiando al modelo de IA hacia patrones seguros; durante la generación, previniendo que se introduzcan vulnerabilidades; y después, usando agentes de IA para revisar el código generado. Es como tener un experto en seguridad susurrándole al oído a la IA. El framework es agnóstico, así que funciona con los jugadores más conocidos del barrio: Cursor, GitHub Copilot, Claude Code y otros.

Contexto e impacto en la industria: ¿Por qué ahora?

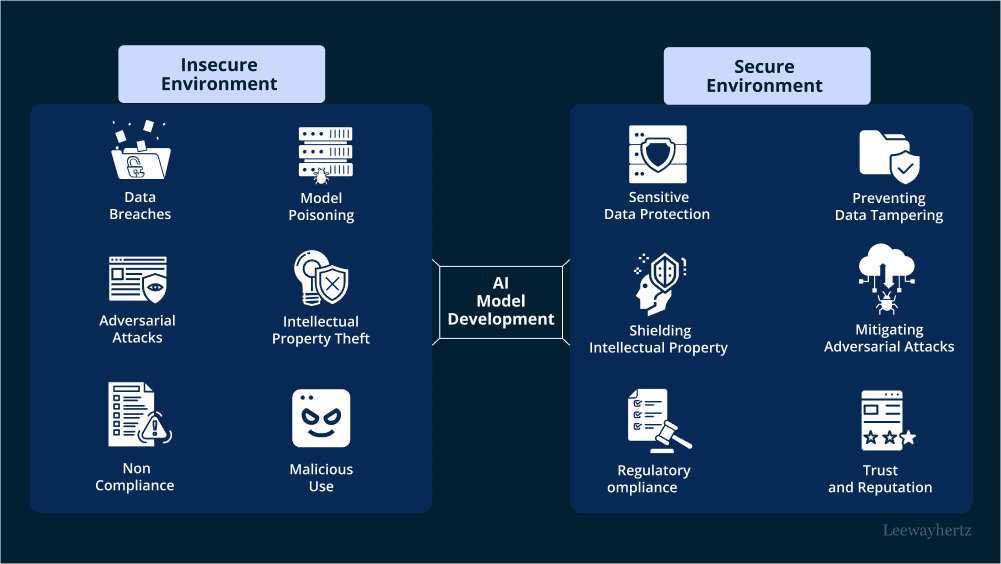

No es casualidad que CodeGuard aparezca en este momento. La adopción de la IA en el desarrollo se disparó, y con ella, la superficie de ataque. El código generado por máquinas, si no se controla, puede ser un coladero de vulnerabilidades. Lo que propone Cisco es un cambio de paradigma: en lugar de auditar el código al final del proceso, la seguridad se convierte en una parte integral y proactiva del desarrollo asistido por IA.

Para nosotros, los desarrolladores, esto significa que nuestro rol sigue evolucionando. Ya no se trata solo de escribir código, sino de supervisar, validar y dirigir a estos nuevos asistentes. Herramientas como CodeGuard nos dan el poder de ser 'arquitectos de sistemas de IA seguros', permitiéndonos aprovechar la velocidad de la IA sin sacrificar la robustez y la seguridad. Es una pieza clave para que la colaboración humano-IA sea sostenible y no una ruleta rusa.

Desafíos y consideraciones éticas: La navaja de doble filo

Ojo, que no todo lo que brilla es oro. CodeGuard es una herramienta fantástica, pero no es una bala de plata. El propio Cisco lo advierte: esto es una capa más de 'defensa en profundidad', no un reemplazo del juicio humano. El mayor riesgo es caer en la complacencia y confiar ciegamente en que la herramienta lo resolverá todo. La responsabilidad final sigue siendo nuestra.

El desafío ético y práctico es encontrar el equilibrio. ¿Cuánta autonomía le damos a un agente que corrige nuestro código? Si una vulnerabilidad se cuela a pesar de las reglas, ¿de quién es la culpa? La transparencia del proceso es fundamental. Debemos entender qué hacen estas herramientas y por qué, para no terminar trabajando con cajas negras que, aunque seguras, nos alejan de la comprensión profunda de nuestro propio software.

Perspectivas futuras: Hacia un estándar de desarrollo seguro con IA

CodeGuard es solo el comienzo. Su roadmap incluye expandir las reglas a más lenguajes, integrar más plataformas de IA y mejorar la validación automática. Lo que estamos viendo es el nacimiento de un estándar de facto para el desarrollo de software asistido por IA. Así como hoy no concebimos un proyecto sin un linter o un sistema de control de versiones, en un futuro cercano será impensable usar un asistente de IA sin un framework de seguridad como este.

La conversación ya no es sobre si la IA escribirá código, sino sobre cómo nos aseguramos de que lo haga bien. Herramientas como CodeGuard son la respuesta. Nos permiten acelerar el desarrollo sin convertir nuestros proyectos en un campo minado de vulnerabilidades. El futuro del desarrollador no es ser reemplazado por una IA, sino convertirse en el director de una orquesta de herramientas inteligentes, y la seguridad es la partitura que todos deben seguir.